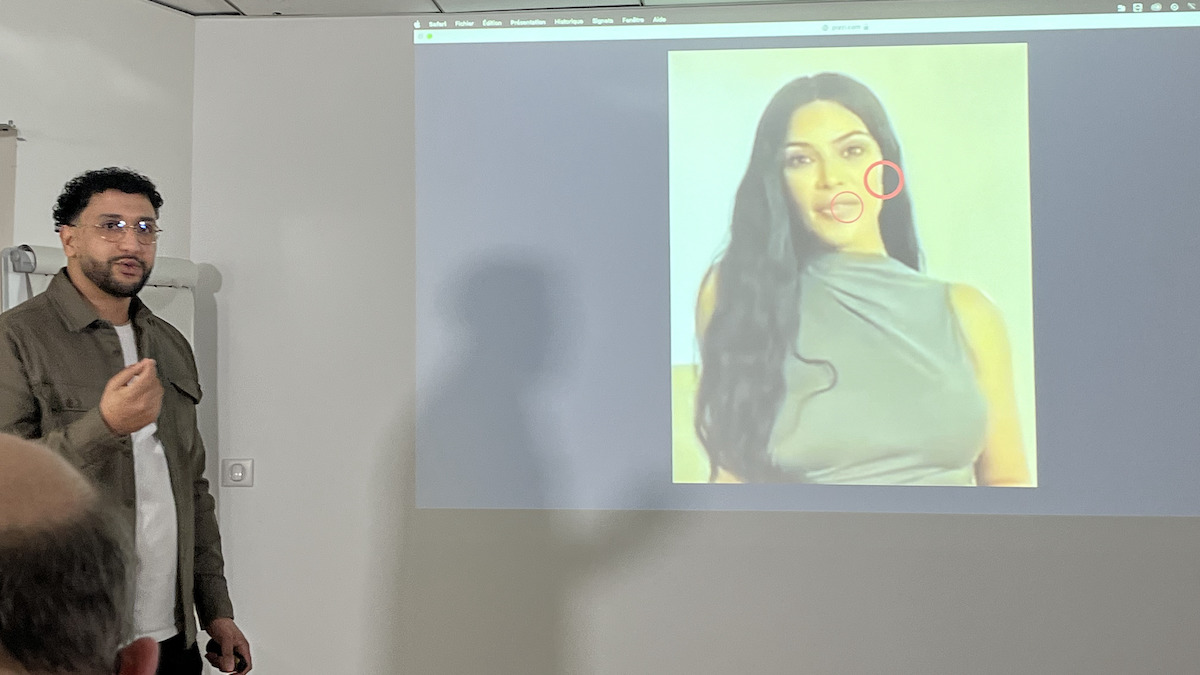

« Est-ce que vous arrivez à deviner quelle vidéo est vraie et laquelle est truquée ? ». C’est la question que pose Disiz Yyov, 25 ans, créateur de contenu et formateur en intelligence artificielle aux jeunes intéressés devant de courts extraits de Barack Obama, de Tom Cruise ou de Kim Kardashian. Ces derniers sont venus nombreux pour assister à une conférence ainsi qu’à des ateliers sur les deepfakes, au sein de l’ISCOM Paris.

L’école de communication a organisé, ce samedi 16 mars 2024, des journées portes ouvertes dans ses 10 campus de l’Hexagone. Le temps d’une journée, les lycéens accompagnés de leurs parents ont pu découvrir l’établissement, mais surtout se sensibiliser aux dangers des deepfakes et des outils de l’IA qui peuvent être utilisés à mauvais escient.

Le créateur de contenu, Disiz Yyov, montre les éléments qui peuvent induire en erreur dans une vidéo truquée de Kim Kardashian. © Diplomeo

« Si l’IA et le deepfake sont entre de mauvaises mains, ça peut être un danger pour l’humanité »

Pendant sa conférence, Disiz Yyov, de son vrai nom Ayoub Farouzi, aborde différents exemples de deepfakes que l’on peut trouver sur la toile. Devant les yeux ébahis des étudiants de l’ISCOM et des lycéens venus se renseigner sur l’école, le créateur de contenu initie un jeu de questions-réponses pour faire deviner au public si une vidéo est authentique ou si elle a été montée de toute pièce.

« Savez-vous pourquoi l’intelligence artificielle est plus forte pour reproduire les vidéos et le corps, mais pas les mains ? », demande Disiz. Les jeunes, hésitants, haussent les épaules. « Tout simplement, car elle a été entraînée sur des milliers d’images qui se focalisent sur ces parties du corps humain ». Voilà pourquoi les images fabriquées à partir de l’IA peuvent parfois montrer des personnes qui ont 6 doigts sur une main.

Selon l’intervenant, les deepfakes remontent à la fin du XIXe siècle. Thomas Edison, inventeur scientifique, aurait été le premier à utiliser de fausses images en 1895 et filmer des scènes cubaines pour raconter la guerre du New Jersey. Puis, en 2014, Ian Goodfellow, ingénieur et informaticien américain a inventé les réseaux antagonistes génératifs (GANs), qui permettent de générer une image fictive à partir d’une sélection de visuels.

Disiz Yyov fait un point sur la pyramide des risques concernant les deepfakes. © ISCOM

« D’ici à 2026, 90 % des contenus diffusés sur internet seront potentiellement générés par l’IA », Disiz Yyov, créateur de contenu et formateur en intelligence artificielle

Les deepfakes ont aussi de bons côtés. « C’est aussi utilisé pour les effets spéciaux au cinéma, non ? », s’interroge un étudiant. « Effectivement, le cinéma et le divertissement ont profité de cette technologie pour améliorer des scènes », lui répond Disiz Yyov. « Dans Star Wars, cela a pu être utilisé pour faire ressusciter un acteur décédé. On peut aussi utiliser l’IA pour traduire et/ou doubler des films. Le deepfake change notre manière de consommer et de chercher l’information. On a pu utiliser des images dans la justice et le journalisme pour raconter et donner des preuves. »

Néanmoins, cela peut aussi avoir de mauvais points. « D’ici à 2026, 90 % des contenus diffusés sur internet seront potentiellement générés par l’IA », alerte Disiz Yyov, car ces derniers prolifèrent sur le web et les réseaux sociaux. « Si l’IA et le deepfake sont entre de mauvaises mains, ça peut être un danger pour l’humanité », poursuit-il. D’où l’importance de s’en prémunir.

Des ateliers de détection et de création des deepfakes pour se prémunir sur les nouvelles technologies

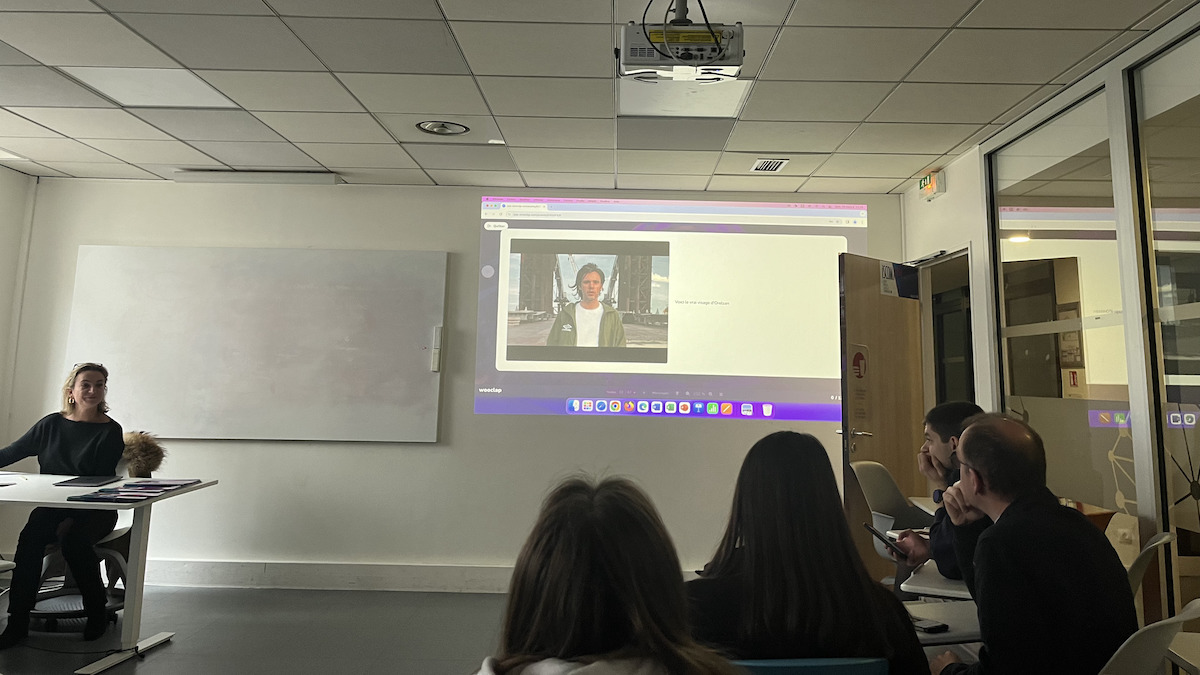

Dans les salles de classe de l’école, des ateliers pour détecter les deepfakes ont été mis en place par les équipes pédagogiques. Les lycéens et les étudiants de l’ISCOM assistent à un atelier de détection des fakes. L’enseignante montre plusieurs cas issus de la culture populaire, des personnages politiques, des chanteurs ou encore d’une publicité. On retrouve notamment une interview d’HugoDécrypte et d’Angèle, une prise de parole de l’animateur Nikos Aliagas, mais aussi de l’ancien président de la République, Nicolas Sarkozy.

Le ton du quiz interactif est donné : à l’aide d’un outil en ligne, les participants peuvent voter « vrai » ou « faux » si ces derniers estiment qu’il s’agit d’un contenu réel, si c’est fictif ou inventé. Par exemple, un extrait du clip d’Orelsan « Basique » est lancé et l’intervenante demande : « Est-ce que c’est bien Orelsan dans le clip de “Basique” ? La réponse était “Faux”.

La présence d’Orelsan dans le clip est bien un deepfake. Un atelier animé par Laurence Gosse, directrice scientifique de la spécialisation événementielle et réputation de l’ISCOM. © Diplomeo

Les visiteurs et les étudiants de l’école pensent trouver la faille, mais tombent régulièrement dans le panneau. En effet, déceler les deepfakes n’est pas si aisé, car certains sont très bien réalisés. “Même si on est prévenus, on peut quand même se faire avoir”, estime une élève. “On se rend compte que même certaines publicités peuvent être truquées”, renchérit un autre.

Pour les enseignants de l’école, sensibiliser leurs étudiants sur l’utilisation des deepfakes et de l’IA en général est essentiel pour leur future vie professionnelle. “La création de contenu est impactée par l’IA”, indique Laurence Gosse, directrice scientifique de la spécialisation événementielle et réputation de l’ISCOM “On leur donne des clés pour bien utiliser cette technologie, car ils sont utiles pour former de futurs influenceurs ou attachés de presse”, ajoute-t-elle. “On sensibilise sur la véracité de l’information, pour éviter qu’ils relayent des fake news”.

Former les futurs spécialistes de la communication sur les enjeux liés à l’IA

La sensibilisation sur les enjeux de l’intelligence artificielle est au cœur des préoccupations des responsables pédagogiques de l’école. C’est la raison pour laquelle l’ISCOM a organisé cette journée portes ouvertes, sous forme de master class sur le sujet. “Il s’agit de montrer à la fois à travers l’atelier d’Ayoub et de nos ateliers de détection, à quel point les IA et le deepfakes peuvent démultiplier la créativité l’explosion de la data qui est gigantesque”, explique Caroline Grassaud, directrice de l’ISCOM Paris.

“On en est encore aux prémices, mais c’est important de leur apporter des compétences pour comprendre quels impacts cela induit sur nos métiers quand on parle de communication, de crise ou de relations publiques”, poursuit-elle.

Les responsables pédagogiques de l’établissement estiment que les deepfakes et la désinformation sont omniprésents au quotidien, sur les canaux sociaux comme aux quatre coins du globe. “Quand on se souvient, il y a quelques mois, de la crise des punaises de lit, on voit qu’il y a eu vraisemblablement une ingérence russe derrière qui est venue perturber tout un ensemble d’institutions en France”, précise Philippe Gisclon, directeur de l’ISCOM Lyon. “Je pense qu’il y a une nécessité de mettre en garde monsieur tout le monde qui est encore accrue pour les communicants, car ils vont être des relais d’information. Il est donc nécessaire de former des élèves éclairés sur ces sujets et qui doivent être éthiques”.

Pour éclairer les étudiants sur les deepfakes et les IA, le choix s’est naturellement porté vers Disiz Yyov, qui forme les entreprises et sa communauté sur le sujet. “On a trouvé, en lui, une démarche de qualité et aussi un discours très pédagogue qui avait de l’information de qualité”, confie Caroline Grassaud. Le créateur de contenu, qui s’intéresse à ces technologies depuis quelques années, a souhaité montrer son expertise et vulgariser toutes les informations sur le sujet, qui peuvent parfois se révéler complexes.

“La désinformation dont les étudiants peuvent être victimes, tomber sur une info qui est totalement fausse, c’est un risque”, insiste Disiz Yyov. “Quand je crée des contenus, je le fais gratuitement. Pour des jeunes qui sont très friands de TikTok, c’était un devoir pour moi d’intervenir dans une école comme celle-ci”.

Auprès de sa communauté, ce dernier admet faire un travail de sensibilisation continu. “Dans mes vidéos, je mets en exergue les bons côtés, dans une démarche d’apprentissage sur comment utiliser ChatGPT ou un autre outil”, explique-t-il. “Quand on s’adresse à une commu, on sait que certains sont susceptibles de mal utiliser l’IA donc j’essaye de montrer un côté positif et de faire oublier le négatif, notamment sur tout ce qui est malveillant”.